«Чёрные ящики». Вы думаете - это начало? А это уже кульминация!

Это выглядит как новая новость. А на самом деле - старая схема.

Последние дни новости выглядят так, будто искусственный интеллект вдруг сорвался с цепи и пошёл выталкивать людей с работы.

23 апреля 2026 года Meta объявила, что сокращает около 8 000 человек, то есть примерно 10% штата, пока одновременно наращивает расходы на AI-инфраструктуру и дорогой найм AI-специалистов. В тот же день стало известно, что Microsoft предлагает buyouts тысячам сотрудников в США. И, конечно, первая мысль у всех очень простая: ну вот, началось, нас теперь будут увольнять ради машин.

Но я полезла смотреть и подумала: ага, сейчас.

Потому что людей начали отодвигать не в тот момент, когда компании стали громко увольнять их под AI-планы.

Это началось раньше.

Сначала людей начали тихо оценивать через системы. Потом — сортировать. Потом — ранжировать. Потом — оборачивать всё это в красивый язык «эффективности» и «комплексной оценки». А уже потом пришла эпоха, где можно и увольнение под это же красиво подшить.

Я недавно поймала себя на смешном моменте: очередной HR-бот вежливо сообщил мне, что решение принято на основе «комплексной оценки».

Комплексной - это какой?

Кем?

На каких данных?

И вот это слово «комплексной» в последнее время звучит почти как новое «не задавайте лишних вопросов».

Я сначала думала, что здесь будет очередная современная история про ChatGPT, генеративный ИИ и все эти красивые новые штуки, которые уже залезли в работу, в найм, в офисную рутину и, кажется, скоро залезут даже в чайник.

Но потом я полезла смотреть глубже и подумала: ага, сейчас.

Потому что самое мутное началось не вчера. Просто раньше оно выглядело не так нарядно.

Тут надо сразу развести две истории, иначе всё превращается в кашу

Люди сейчас очень любят складывать всё под одно слово «ИИ», а потом уже из этого комка делать выводы.

Но здесь на самом деле живут две разные истории.

Первая - старая, скучноватая, но очень влиятельная. Это algorithmic management. Я полезла посмотреть, что это вообще значит по-человечески. Оказывается, всё довольно прозаично: начальство начинает управлять людьми через софт. Софт считает баллы, раскидывает задачи, следит за активностью, прогнозирует «риск ухода», шлёт сигналы о дисциплине и всё чаще лезет даже в кадровые решения.

А вторая - более свежая и уже всем заметная. Это generative AI. По-простому: тот самый ИИ, который сам пишет, суммирует, формулирует, рисует и делает вид, будто всё понял лучше нас. Вот эти чат-ассистенты, автосводки встреч, шаблоны HR-коммуникаций, «умные» фидбеки и красивая обвязка вокруг старых решений - это уже оттуда.

И вот что интересно.

Главный нерв этой темы - не во второй истории, а в первой.

Вторая просто делает первую приятнее на вид.

Потом я полезла в свежие цифры, и там уже не до красивых разговоров

Если смотреть на более свежую международную рамку, а не только на старые обзорные исследования, картина довольно взрослая.

Stanford AI Index 2026 пишет, что в 2025 году 88% организаций уже использовали ИИ хотя бы в одной бизнес-функции. А генеративный ИИ использовался хотя бы в одной функции уже у 70% организаций.

То есть это больше не игрушка для презентаций и не пилот, который кто-то крутит в дальнем углу.

А потом я отдельно полезла в OECD 2025 про algorithmic management на рабочих местах. То есть уже не про абстрактный ИИ, а про то, насколько часто компании реально управляют людьми через такие системы. И вот там уже совсем по-земному:

- в США 90% менеджеров говорят, что их компании используют хотя бы один такой инструмент;

- в европейских странах выборки - Франции, Германии, Италии и Испании - средний уровень уже 79%.

По-простому: цифровой слой управления людьми уже давно врос в рабочую среду.

Не везде одинаково, не по одним и тем же правилам, не в одинаковом масштабе - но это уже точно не экзотика.

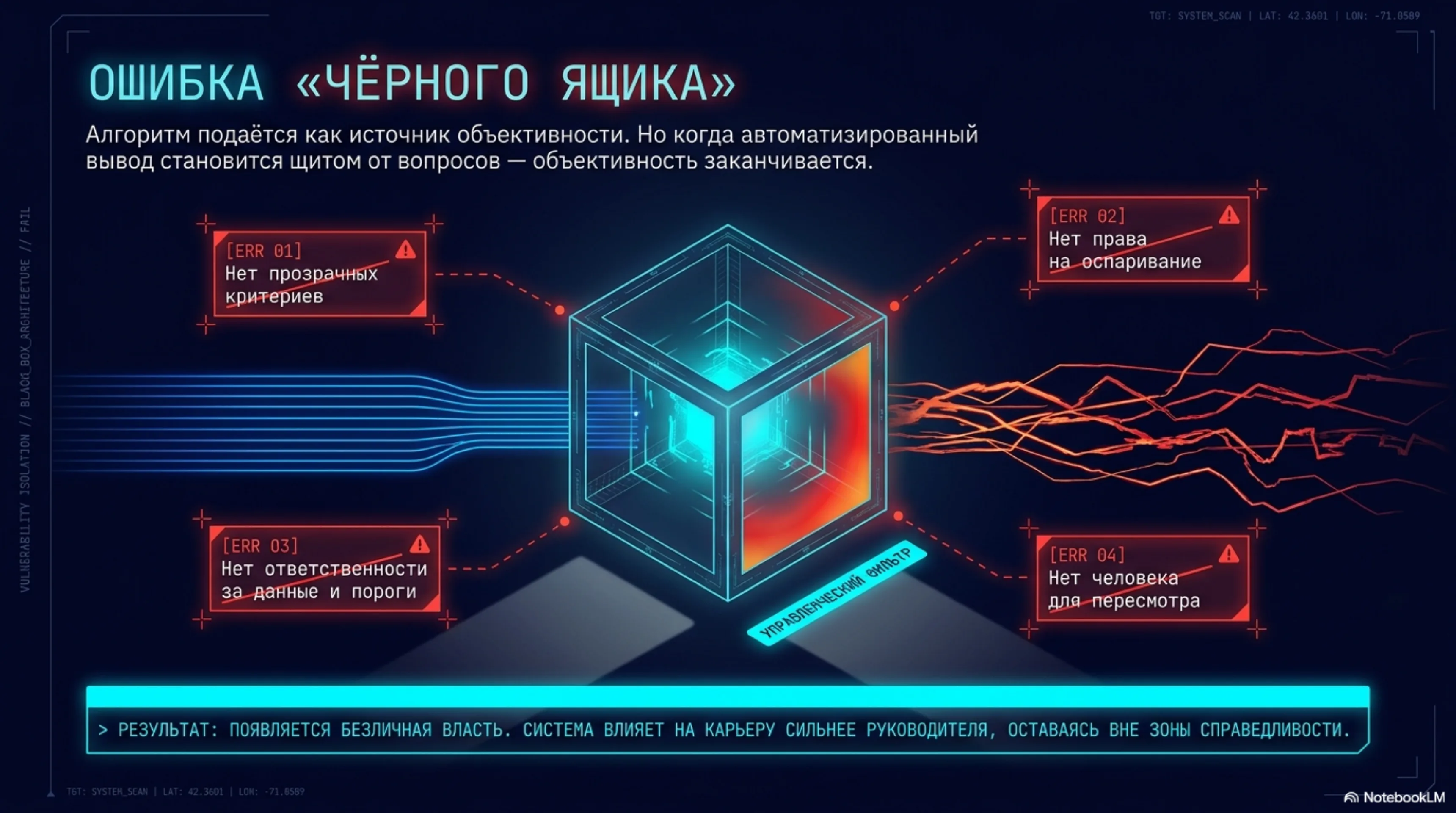

Самое неприятное начинается там, где надо объяснить решение

Ошибки бывают у всех. Люди ошибаются, менеджеры ошибаются, таблицы ошибаются, модели тоже ошибаются.

Но меня здесь больше всего цепляет не сама возможность ошибки.

Меня цепляет вот этот момент, когда решение уже есть, последствия уже есть, а объяснения по-человечески нет.

В том же OECD 2025 почти две трети менеджеров, которые уже используют такие инструменты, сами говорят, что у них есть опасения по поводу влияния этих систем на работников.

И какие у них главные страхи?

- неясно, кто отвечает, если решение оказалось неверным;

- трудно проследить логику алгоритмического решения;

- плохо защищены психическое и физическое благополучие работников.

То есть проблема уже не звучит как «люди просто боятся технологий».

Она звучит как очень взрослая и очень неприятная вещь: система влияет на человека, а контур ответственности и объяснения размазан.

А после 2023 года это всё ещё и стало очень удобным

Вот тут как раз и начинается уже наша нынешняя эпоха.

Раньше у компании мог быть просто унылый скоринг, серый дашборд и набор метрик, которые никто толком не любит, но все терпят.

А теперь поверх этого появляется красивый слой: бот суммирует интервью, помощник ранжирует кандидатов, система пишет аккуратные фразы для отказа, интерфейс вежливо пересказывает результат и делает вид, будто всё понятно.

Именно поэтому сегодня эта тема ощущается острее.

Потому что старый чёрный ящик никуда не делся. Ему просто приделали приятный голос и вежливую мордочку.

В EEOC 2024 - это американская комиссия по равным возможностям в трудовой сфере - для работников перечисляются очень конкретные вещи: автоматический отбор резюме, анализ видеособеседований, чат-боты, мониторинг времени на задачах, геолокации, голоса, выражения лица, нажатий клавиш и даже движения курсора.

И вот тут уже трудно делать вид, что всё это где-то там далеко, в лаборатории.

Нет. Это уже обычный рабочий воздух.

Небольшой исторический урок, который всё ещё полезен

Кейс Amazon 2018 года вспоминают так часто, что он уже почти превратился в мем. Но он полезен не как страшилка, а как очень ранний звоночек.

Смысл там был очень простой. Система найма обучалась в основном на старых резюме, где большинство успешных анкет были мужскими. И дальше она сделала свой очень “умный” вывод: раз в прошлом чаще одобряли мужчин, значит мужской профиль и есть более правильный.

Из-за этого она начала принижать часть женских резюме.

Я это когда первый раз увидела, у меня была совсем не академическая мысль. Типа: ну прекрасно. Мало того что нас десятилетиями мерили по мужским правилам, так они ещё и взяли эти старые правила, аккуратно загрузили в железную болванку и заставили её делать то же самое, только уже с умным лицом.

То есть мы как будто не вперёд пошли, а просто выдали старому перекосу новый бейджик и назвали это инновацией.

И вот тут важно не впадать в детскую крайность «все алгоритмы обязательно дискриминируют».

Нет.

Урок здесь другой.

Если модель кормить кривым прошлым и не проверять, она начинает повторять старые человеческие перекосы, только уже быстрее, тише и с видом «объективного результата».

Вот это и есть самая ехидная часть всей истории.

То, что раньше было просто человеческим перекосом, теперь можно завернуть в красивую цифровую процедуру и назвать нейтральной оценкой.

Европа, кстати, уже сказала: секундочку

Мне вообще нравится, что самые внятные слова по этой теме сейчас часто идут не от продавцов AI-чудес, а от регуляторов.

EU AI Act вступил в силу 1 августа 2024 года. И важен он не потому, что это громкий закон с красивым названием, а потому что инструменты для employment, management of workers and access to self-employment там уже относят к высокому риску.

Я специально полезла смотреть эту формулу, потому что в таком виде она и правда звучит как заклинание. А по-человечески там смысл очень простой: речь о системах, которые помогают решать, кого взять на работу, как потом этим человеком управлять и дадут ли ему вообще нормально зарабатывать самостоятельно. То есть если софт лезет в найм, в рабочую жизнь человека и в его возможность самому себе зарабатывать, Европа уже считает это опасной зоной, а не милой автоматизацией.

То есть, по-простому, Европа говорит компаниям очень понятную вещь:

если ваша система влияет на найм, увольнение, продвижение, оценку и доступ к возможностям, это уже не «внутренняя оптимизация, не мешайте нам».

К таким штукам должны быть требования: к данным, к прозрачности, к человеческому надзору, к управлению рисками.

И, честно, это очень здоровый сдвиг.

Потому что кто-то наконец вслух сказал: нельзя прикрывать кадровые решения словом AI так, будто это автоматически снимает с вас ответственность.

А человеку-то что со всего этого

А человеку, если честно, от этого довольно зябко.

Потому что он сталкивается с такими системами не как исследователь и не как человек, который любит читать OECD за утренним кофе. То есть не как я сейчас, когда специально сижу и ковыряю отчёты, а просто как живой человек, которому надо устроиться на работу, удержаться на ней или понять, почему к нему вдруг начали относиться иначе.

Он сталкивается с ними тогда, когда и так уязвим.

Когда ищет работу.

Когда пытается понять, почему рейтинг вдруг поехал вниз.

Когда ему не объясняют, почему задачи стали прилетать иначе.

Когда ему говорят, что он «ниже порога», но не показывают, где вообще этот порог стоял.

И вот в этот момент все разговоры «ну это просто инструмент» как-то резко теряют обаяние.

Потому что любой инструмент, который влияет на карьеру, репутацию, доход и доступ к возможностям, уже перестаёт быть просто инструментом.

Он становится частью власти.

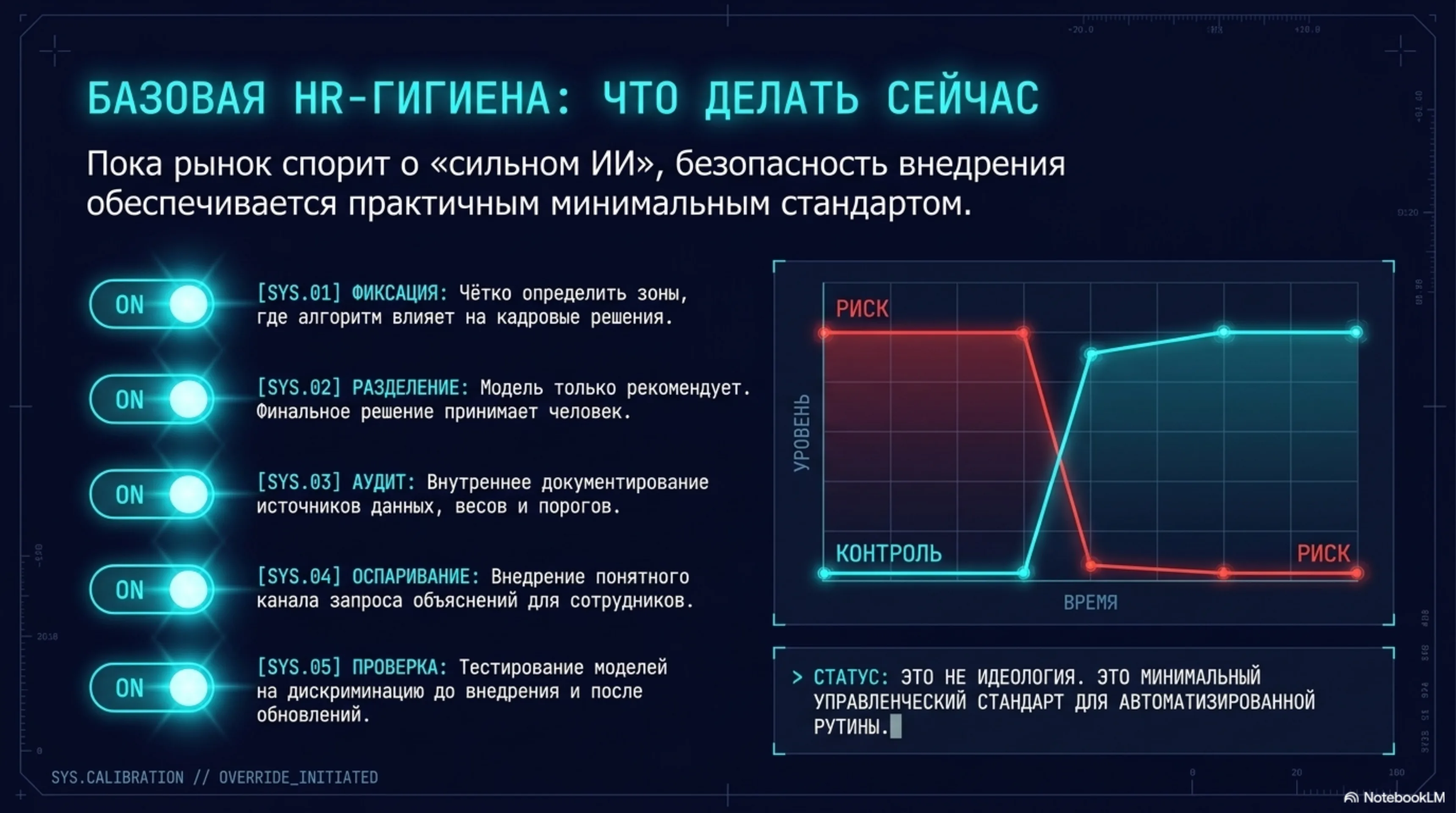

Что можно требовать уже сейчас - без истерики, но и без розовых очков

Тут, на самом деле, не нужно изобретать волшебство.

Я бы у такой компании спрашивала прямо в лоб:

- где именно используется автоматизированная оценка;

- что система вообще оценивает;

- какие данные она ест;

- кто может пересмотреть её вывод;

- куда идти, если человек не согласен;

- кто будет отвечать, если система ошиблась.

И да, мне всё ещё кажется очень важным одно простое правило: нельзя прятать управленческое решение за фразой «так решила система».

Если за этой фразой больше ничего нет, это не прогресс. Это просто удобная форма безответственности.

И вот мой итог

Если совсем коротко, то у меня вывод сложился такой.

Публичная эпоха разговорного ИИ действительно началась поздно - в конце 2022 года.

Но эпоха управленческих чёрных ящиков началась раньше.

И, кажется, мы слишком долго делали вид, что это просто техническая деталь.

А это не деталь.

Это уже вполне взрослая история про власть, объяснимость и очень удобное человеческое желание спрятать решение за экраном.

И вот это, по-моему, главное, что здесь не надо перепутать:

старый чёрный ящик не появился из ChatGPT.

Он просто стал ближе к человеку, когда на него сверху надели красивый генеративный интерфейс.

Отдельно скажу про материалы. В этом тексте я сознательно держала старые кейсы вроде Amazon 2018 только как предысторию проблемы, а основной каркас собирала уже по более свежей рамке: Stanford AI Index 2026, OECD 2025 по управлению людьми через алгоритмические системы, совместному отчёту ILO и Европейской комиссии за 2024 год, материалам EEOC для работников за 2024 год и нормативной логике EU AI Act после вступления его в силу 1 августа 2024 года.